我们很高兴地宣布,我们近期发表的期刊论文「基于交叉三融合注意力机制的多分支美学与技术视角下的无参考视听质量评估」已于本月(2026年3月)在《IEEE视频技术电路与系统学报》(TCSVT)被接收。论文由本院与香港理工大学合作完成:

- Ngai-Wing Kwong, Yui-Lam Chan, Ziyin Huang, and Sik-Ho Tsang, “Multi-Branch Aesthetic and Technical Perspectives with Cross Tri-Fusion Attention for No-Reference Audio-Visual Quality Assessment,” IEEE Transactions on Circuits and Systems for Video Technology, doi: 1109/TCSVT.2026.3674552.

論文連結:https://ieeexplore.ieee.org/document/11435472

论文摘要

在当今资讯快速传播、短视频在Instagram、YouTube和TikTok等社交媒体平台上占据主导地位的时代,确保高质量的音频和视频变得日益重要。传统的质量评估方法通常只专注于音频或视频的某一部分,然后将结果合并。然而,这种方法忽略了音频和视频之间的相互作用,而这种相互作用会影响观众对视频的体验。

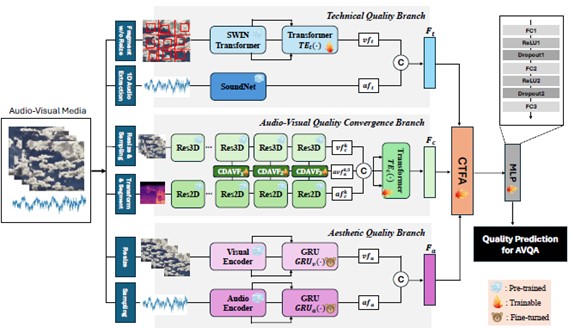

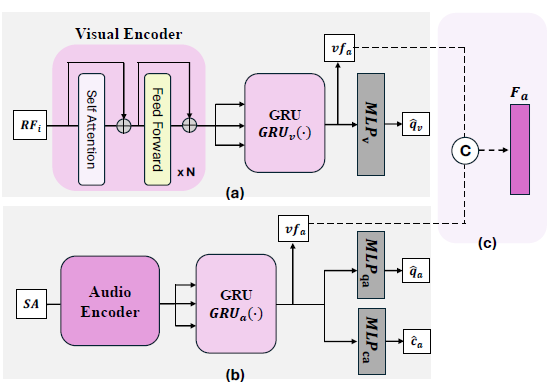

为了解决这个问题,我们开发了一种新的模型,可以同时评估音频和视频质量。该模型包含多个部分(或“分支”),每个部分都专注于质量的不同方面。其中一个部分采用了一种我们称为跨维度音频视频融合(CDAVF)的新技术,该技术有助于模型理解音频和视频如何相互影响。另一个部分检视失真或噪音等技术问题,而第三部分则着重内容对观众的愉悦感和意义。

在收集了所有这些资讯之后,我们的模型采用了一种名为交叉三融合注意力机制(CTFA)的新方法,将所有资讯智能地融合在一起,从而做出更准确的质量判断。

我们使用专业视频资料集和用户生成的视频资料集测试了我们的模型,发现其性能始终优于现有方法。这表明我们的方法在评估音视频内容的整体质量方面更加准确可靠。

我们将继续深化与顶尖研究机构的合作,共同开发尖端技术!

研究团队成员

香港珠海学院

曾锡豪博士,资讯科学学系助理教授

香港理工大学

邝毅荣博士,电机及电子工程学系博士后研究员

陈锐霖博士,电机及电子工程学系副教授兼副系主任

黄子茵博士,电机及电子工程学系博士后研究员

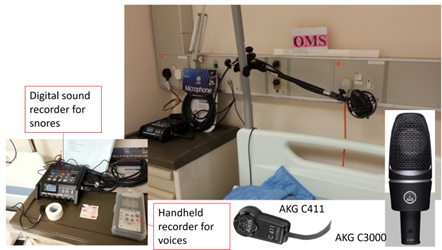

一些关于学术论文的照片

我们提出的NR-AVQA神经网络模型的总体框架。

我们在美学质量方面提出的微调流程。