基於多幀時空特徵和分層學習的無參考屏幕視頻質量品質評估方法

我們很高興地宣布,我們近期發表的期刊論文「基於多幀時空特徵和分層學習的無參考屏幕視頻質量品質評估方法」已於本月(2025年10月)在《IEEE多媒體學報》(TMM)上發表。論文由本院與香港理工大學合作完成:

- Ngai-Wing Kwong, Yui-Lam Chan, Sik-Ho Tsang, Ziyin Huang and Kin-Man Lam, “Multi-Frame Spatiotemporal Feature and Hierarchical Learning Approach for No-Reference Screen Content Video Quality Assessment,” in IEEE Transactions on Multimedia, vol. 27, pp. 7632-7647, 2025, doi: 10.1109/TMM.2025.3599071.

論文連結:https://ieeexplore.ieee.org/document/11124545/

論文摘要

隨著遠距辦公和線上會議的日益普及,螢幕內容視訊(SCV)的使用也大幅增加。這使得檢測和維護視頻品質變得尤為重要。傳統方法通常需要原始影片作為參考,但原始影片並非總是可用。其他現有方法嘗試在沒有參考的情況下評估視訊質量,但往往只關注簡單的特徵,而忽略了重要的視覺和運動訊息。

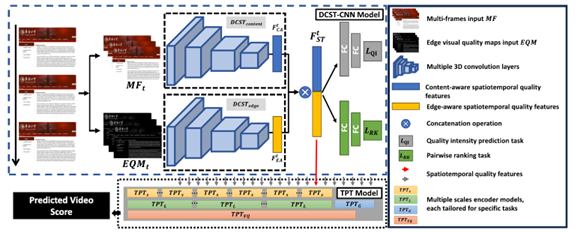

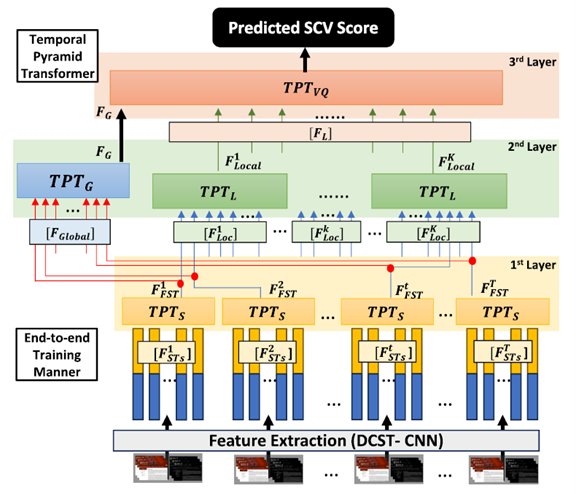

我們開發了一種基於人工智慧的新型系統,無需原始影片即可評估螢幕內容影片的品質。該系統設計了一種神經網絡,即雙通道時空卷積神經網路(DCST-CNN),它同時關注影片的主要內容和邊緣,以捕捉時空上的重要細節。為了更好地理解視訊隨時間的變化,我們添加了一個時間金字塔Transformer(TPT)模組,用於融合短時間段和長時間段的信息。

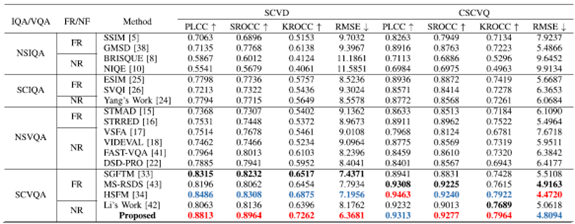

這兩個模組共同作用,幫助系統學習更詳細的視訊特徵,從而更準確地預測視訊品質。我們的測試表明,該方法優於現有的無參考方法,因此非常適用於線上協作和螢幕共享等對視訊品質要求極高的實際應用場景。

我們將繼續深化與頂尖研究機構的合作,共同開發尖端技術!

研究團隊成員

香港珠海學院

- 曾錫豪博士,資訊科學學系助理教授

香港理工大學

- 鄺毅榮博士,電機及電子工程學系博士後研究員

- 陳銳霖博士,電機及電子工程學系副教授

- 黃子茵博士,電機及電子工程學系博士

- 林建文教授,電機及電子工程學系教授

一些關於學術論文的照片

我們提出的神經網路模型的整體框架。

我們提出的TPT模組的網路架構。

SCVQA模型在兩個SCVQA資料庫上的效能比較。