我们很高兴地宣布,我们近期发表的期刊论文「基于多帧时空特征和分层学习的无参考屏幕视频质量品质评估方法」已于本月(2025年10月)在《IEEE多媒体学报》(TMM)上發表。論文由本院與香港理工大學合作完成:

- Ngai-Wing Kwong, Yui-Lam Chan, Sik-Ho Tsang, Ziyin Huang and Kin-Man Lam, “Multi-Frame Spatiotemporal Feature and Hierarchical Learning Approach for No-Reference Screen Content Video Quality Assessment,” in IEEE Transactions on Multimedia, vol. 27, pp. 7632-7647, 2025, doi: 10.1109/TMM.2025.3599071.

论文连结:https://ieeexplore.ieee.org/document/11124545/

论文摘要

随着远距办公和线上会议的日益普及,萤幕内容视讯(SCV)的使用也大幅增加。这使得检测和维护视频品质变得尤为重要。传统方法通常需要原始影片作为参考,但原始影片并非总是可用。其他现有方法尝试在没有参考的情况下评估视讯质量,但往往只关注简单的特征,而忽略了重要的视觉和运动讯息。

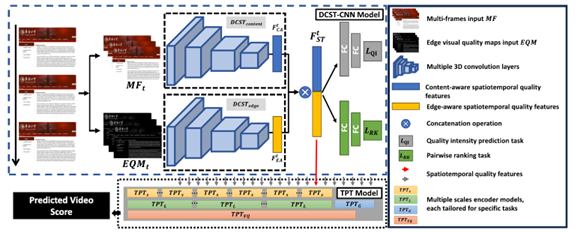

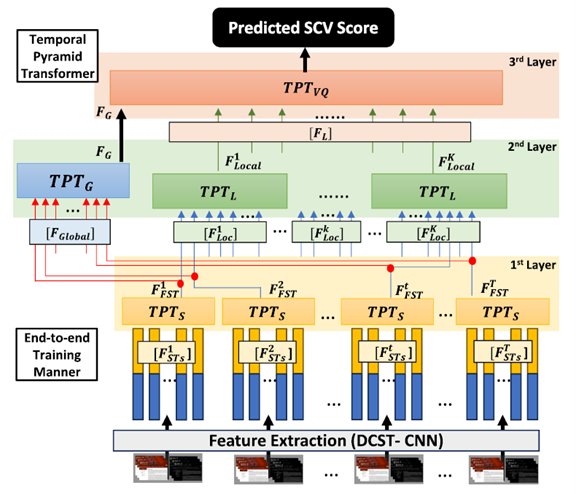

我们开发了一种基于人工智慧的新型系统,无需原始影片即可评估萤幕内容影片的品质。该系统设计了一种神经网络,即双通道时空卷积神经网路(DCST-CNN),它同时关注影片的主要内容和边缘,以捕捉时空上的重要细节。为了更好地理解视讯随时间的变化,我们添加了一个时间金字塔 Transformer(TPT)模组,用于融合短时间段和长时间段的信息。

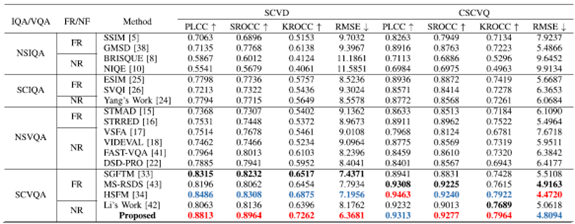

这两个模组共同作用,帮助系统学习更详细的视讯特征,从而更准确地预测视讯品质。我们的测试表明,该方法优于现有的无参考方法,因此非常适用于线上协作和萤幕共享等对视讯品质要求极高的实际应用场景。

我们将继续深化与顶尖研究机构的合作,共同开发尖端技术!

研究团队成员

香港珠海学院

- 曾锡豪博士,资讯科学学系助理教授

香港理工大学

- 邝毅荣博士,电机及电子工程学系博士后研究员

- 陈锐霖博士,电机及电子工程学系副教授

- 黄子茵博士,电机及电子工程学系博士

- 林建文教授,电机及电子工程学系教授

一些关于学术论文的照片

我们提出的神经网络模型的总体框架。

我们提出的TPT模块的网络架构。

SCVQA模型在两个SCVQA数据库上的性能比较。