我們很高興地宣布,我們近期發表的期刊論文「基於交叉三融合注意力機制的多分支美學與技術視角下的無參考視聽質量評估」已於本月(2026年3月)在《IEEE視頻技術電路與系統學報》(TCSVT)被接收。論文由本院與香港理工大學合作完成:

- Wai Lun Lo, Kwok Wai Wong, Richard Tai Chiu Hsung, Henry Shu Hung Chung, Hong Fu, Harris Sik Ho Tsang, and Tony Yulin Zhu, “A Range-Aware Attention Framework for Meteorological Visibility Estimation,” MDPI Sensors, 26(6), 1893, 2026, doi: 3390/s26061893.

論文連結:https://www.mdpi.com/1424-8220/26/6/1893

論文摘要

氣象能見度估計是指估算在不同天氣條件下我們所能看到的範圍。準確估計能見度對於安全交通和環境監測至關重要。然而,即使是先進的深度學習模型,在能見度因霧、霾或其他大氣效應而發生複雜、非線性變化時,其性能也往往不佳。另一個挑戰是,能夠將影像與基於感測器的精確能見度測量資料相結合的資料集非常有限。

本研究主要貢獻有兩項。首先,我們建構了一個名為香港珠海學院能見度資料集(HKCHC-VD)的新資料集。該資料集包含超過11,000張高品質影像,每張影像都與從專業Biral SWS-100氣象感測器擷取的精確能見度讀數相符。

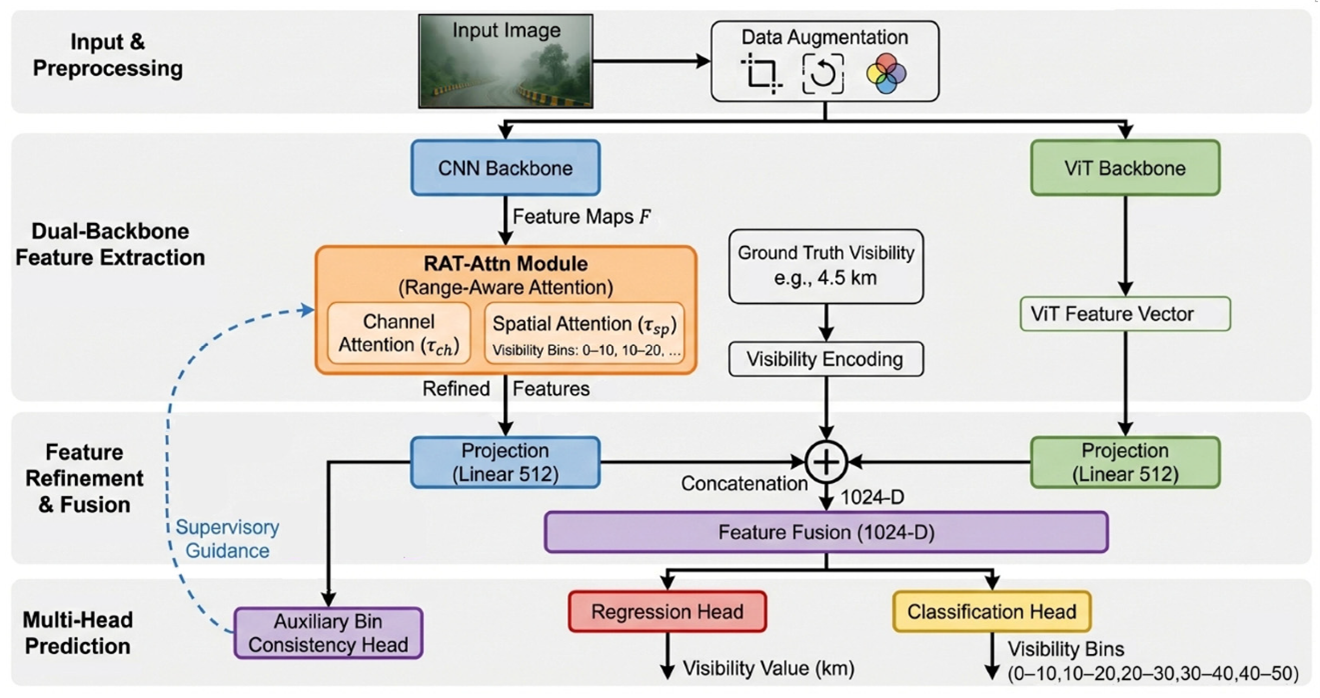

其次,我們發展了一種名為範圍感知注意力(RAT-Attn)的新型深度學習框架。該系統透過使用一種能夠適應不同能見度範圍的特殊注意力機制,將氣象資訊直接融入深度模型中。它結合了兩種類型的網路——卷積神經網路 (CNN) 和視覺變換器 (ViT)——並包含一個可學習的閾值,幫助模型針對不同距離聚焦於正確的圖像特徵。

實驗表明,RAT-Attn 的性能明顯優於現有的能見度估計模型(例如 VisNet 和較早的基於人工神經網路的模型)。性能最佳的版本(ResNet + ViT,具有空間閾值)實現了高精度,均方誤差為 5.87 km²,平均絕對誤差為 1.65 km,分類任務準確率達到 87.07%。值得注意的是,在低能見度(0-10 km)情況下,與以往方法相比,其誤差降低了 75% 以上。

我們將繼續深化與領先研究機構的合作,共同開發前沿技術!

研究團隊成員

香港珠海學院

盧葦麟教授,資訊科學系教授兼系主任

黃國威先生,資訊科學系研究助理

熊體超博士,資訊科學系副教授

曾錫豪博士,資訊科學系助理教授

朱禹林博士,資訊科學系助理教授

香港城市大學

鐘樹鴻教授,電機工程系講座教授

香港教育大學

傅弘博士,數學與資訊科技系副教授

一些關於學術論文的照片

我們提出的範圍感知注意力框架(RAT-Attn)的端對端架構。

BIRAL SWS-100 能見度傳感器